當AI每天生成3萬首音樂,作曲家還剩下什麼?張玹把答案放進《眾人協奏曲》

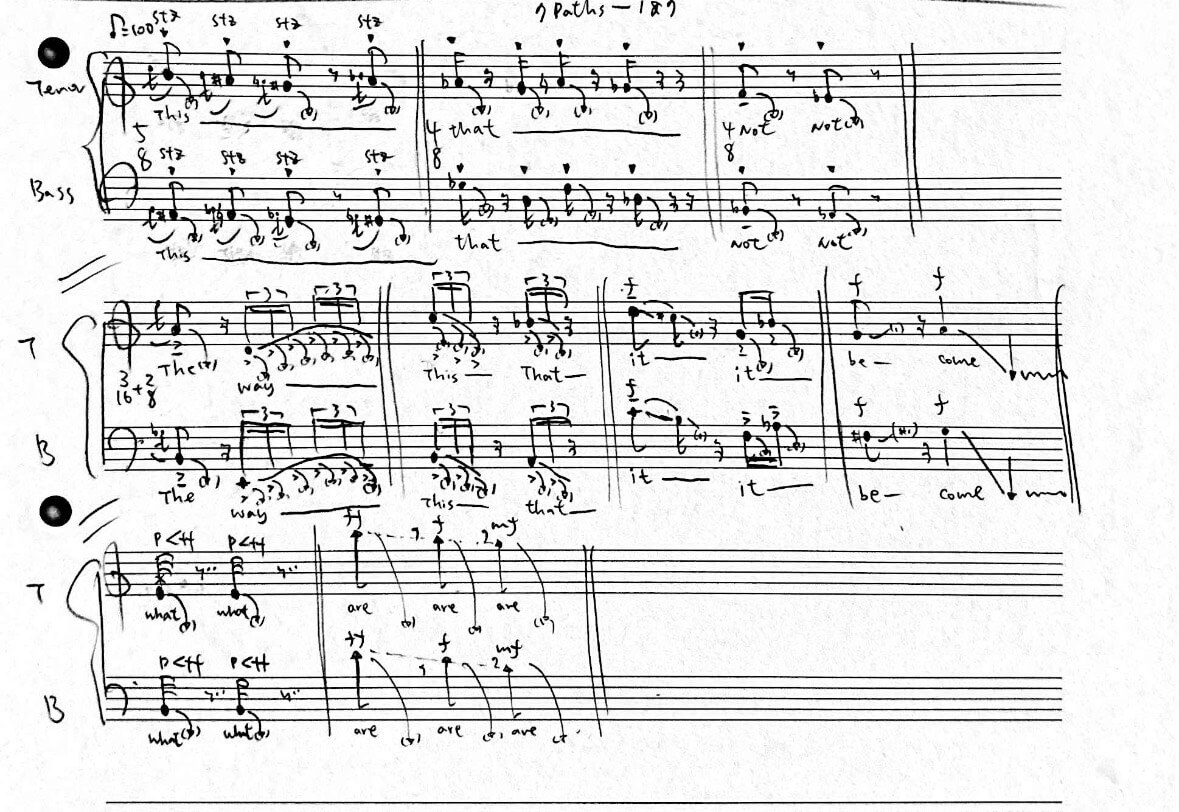

《眾人協奏曲》將在2026年4月10日至12日於衛武營戲劇院演出,全長約60分鐘。這件作品由作曲家張玹與裝置藝術家馬圓媛共同創作,編舞家劉奕伶、笙演奏家李俐錦,還有比利時強音當代古典樂團Ictus Ensemble共同參與。舞台中央是一個由63格聲響單元構成的裝置,觀眾會分批進入其間,同一時間約15人參與,邊走、邊停、邊聽,也在移動裡直接觸發聲音。

當串流平台每天持續湧入AI生成音軌,音樂裡最容易被複製的部分,正在快速變成資料、模型與算力的問題。張玹沒有回頭替舊的創作權威辯護,也沒有急著把技術排除在外。他把問題直接搬進劇場,《眾人協奏曲》讓觀眾用當代劇場內那些演出過程中的腳步、停下來的瞬間、轉身的角度,還有彼此或近或遠的距離,現場把聲音做出來。

把觀眾放進樂曲裡

《眾人協奏曲》最吸引人的部分,在於它把作曲從紙上拉回身體。沒有指揮、沒有固定座位、也沒有對你欣賞的諸多限制。你往前一步、你停下來、你轉身,感受到的都會跟上一秒不相同、即便是旁人的位置也會改變整體聲場。

來自斯圖加特當代人聲團與比利時強音當代古典樂團 Ictus Ensemble 的錄音素材,先被拆解、再被重新編排進場域裡,等著人的動作把它們重新接起來。對於演出的感受可能很直接,靠的不是技巧展示,而是作為觀眾把身心靈進入空間後留下的反應。

張玹曾把靈感回到很早的一段記憶。小時候推著學步車往前走,步伐一動,叮、咚、噹就跟著響。身體一動,聲音就成立。那種關係後來被放大成《眾人協奏曲》的核心結構。到了這個作品裡,劇場不再只是容納表演的地方,它自己就是樂器,觀眾走進去之後,聲音才真正開始運作。舞者劉奕伶與笙演奏家李俐錦的加入,也讓這個空間多了另一層呼吸與推力。布面的翻動、氣息的進出、現場即時生成的聲場,讓作品始終維持在流動的狀態裡。

AI的大規模接手

談到AI音樂的文章,張玹認為真正碰到的核心不是機器會不會寫歌,而是哪一類音樂工作已經開始被模型大規模接手。這幾年最明顯的是那些有大量資料可供學習、風格輪廓清楚、用途也很穩定的音樂類型。

法國串流平台 Deezer 在2025年9月公布,平台每天收到超過3萬首完全由AI生成的音軌,占每日上架總量28%。當這個數字持續往上衝,問題很快就不只剩下好不好聽,還包括我們到底怎麼辨認聲音裡的來源、勞動與真實性。

Velvet Sundown 把這件事推得更前面。這個在2025年突然出現在 Spotify 推薦裡的名字,沒有清楚的演出脈絡,也幾乎沒有能被追索的真人足跡,後來才承認整個計畫由AI生成,包含音樂、形象與團隊敘事。麻煩的地方不在於有人被騙,而在於很多人一開始並不是從聲音本身聽出異樣。感受先發生,真相晚一步補上來,問題也因此變得更難。當聽眾說一首歌曾經打動自己,那份感受會不會因為後來知道來源而被改寫,這才是AI音樂現在真正逼近人的地方。

當代作曲還剩下什麼

這也是《眾人協奏曲》值得被放進這個討論裡的原因。沒有躲開技術,把感測系統、即時運算、動態分析這些看似與AI高度配合的部分都放在作品裡,但這些技術沒有被拿來替代人的參與,它們被用來放大人在現場的差異。每一場都會因為參與者的速度、距離、猶豫、停留而改變。有人走得快,聲音會被推散;有人在某格停久一點,空間的重心就往那邊傾過去。這些差異很小,卻也正是作品成立的地方。你得真的在那裡,和別人一起走過去,這首曲子才會長成那一次的樣子。

這也讓張玹提出的問題變得具體:當AI可以快速生成一首像樣的音樂,真正稀缺的東西,可能已經不是聲音本身了。古典當代音樂之所以還站得住,不只是因為資料量還沒大到足以餵飽模型,也因為它一直有一塊很難被壓縮的東西,那就是時間。作品要不要留下來要靠很多年後還有沒有人願意再演、再排、再聽。《眾人協奏曲》把這件事往前推了一步,把作曲從完成品挪回過程,讓人重新看到音樂仍具有其價值、也仍只會在同一個空間裡,靠一群人共同在場創造出來。

演出資訊:

【2026衛武營國際音樂節】張玹《眾人協奏曲》

時間:2026年4月10日19:30、20:00、20:30 / 2026年4月11-12日14:30、15:00、15:30

地點:高雄衛武營國家藝術文化中心戲劇院

購票連結:https://www.opentix.life/event/1986308298138669057?srsltid=AfmBOoqvBXl01LqbpT-urV50EL70Cm4J8YooXeg8yEhoGJ_4cMIxHZpf

➤ 訂閱實體雜誌請按此

➤ 單期購買請洽全國各大實體、網路書店

VERSE 深度探討當代文化趨勢,並提供關於音樂、閱讀、電影、飲食的文化觀點,對於當下發生事物提出系統性的詮釋與回應。